Skrivni dokumenti: Facebook kaže, da funkcije in dobiček nad varnost uporabnikov

Facebook, 13-letni behemot z 1,23 milijardami aktivnih uporabnikov, ustvari več kot 8 milijard dolarjev na četrtletje prihodkov - od tega 3 milijarde dolarjev neto dohodka (npr. Dobiček).

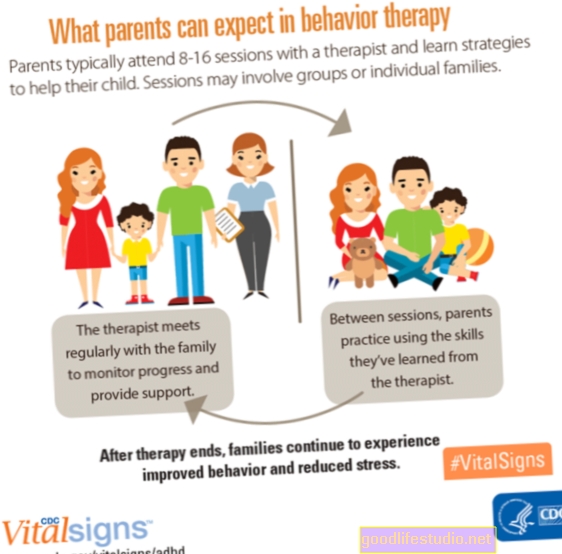

Toda zdi se, da je Facebook s tako številnimi uporabniki varnost uporabnikov spustil v drugo strahu. Do začetka letošnjega leta je Facebook pregledoval vsebine le 4.500 ljudi. Kar se sliši veliko ljudi, dokler ne ugotovite, da si jih deli 1,23 milijarde aktivnih uporabnikov milijard vsak dan, pri čemer se vsak dan vloži na milijone pritožb uporabnikov glede Facebook vsebin.

Ali ima Facebook resen problem z varnostjo uporabnikov? Pravkar objavljena Skrbnik pregled tajnih notranjih dokumentov kaže, da je težava brez nadzora.

Facebook je priznal, da ima nekakšne težave, ko se je v začetku letošnjega leta strinjal, da skoraj ne podvoji svojega revizijskega osebja - na 7.500 - zaradi očitkov, da podjetje preprosto ne dela (ali ga morda skrbi?), Kadar se na njegovi platformi trguje s potencialno škodljivo vsebino . Ne podvojiš svojega moderatorskega osebja, če je vse hudomušno.

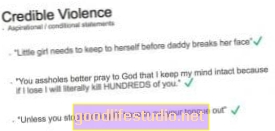

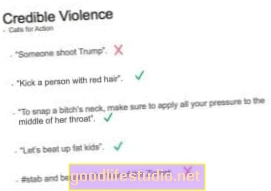

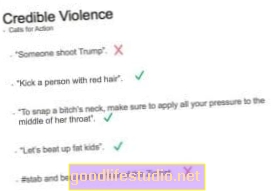

Zdaj, (UK) Guardian je objavil osupljive podrobnosti Facebook-ovih smernic za moderiranje vsebine, izločenih iz več kot 100 tajnih, notranjih priročnikov za usposabljanje in dokumentacijo. Malce moti vse te pomembne stvari ni niti v enem priročniku, ki ga Facebookovi moderatorji prejmejo, ko so najeti.Namesto tega se zdi, da gre za posamičen pristop k politiki, kar ima za posledico nasprotujoče si informacije, neenakomerno zmernost in zelo malo zanesljivosti, kako njene moderirajoče politike dejansko delujejo v resničnem svetu.

"Facebook ne more obdržati nadzora nad svojo vsebino," je dejal en vir. "Preveč je postalo prehitro."

Številni moderatorji naj bi bili zaskrbljeni zaradi nedoslednosti in posebnosti nekaterih pravilnikov. Tisti, ki so na primer spolne vsebine, naj bi bili najbolj zapleteni in zmedeni.

V člankih je zapisan le en majhen primer, koliko vsebine Facebook moderira: "En dokument pravi, da Facebook na teden pregleda več kot 6,5 milijona poročil o potencialno ponarejenih računih - znanih kot FNRP (ponaredek, ne resnična oseba)." In to samo za lažne račune. Predstavljajte si, koliko milijonov dodatnih poročil je za dejansko vsebino.

Značilnosti pred mislijo

Preden se pomisli, kako bi ljudje lahko uporabili (in zlorabili) novo funkcijo, se zdi, da Facebook daje prednost premikanju stvari in ugotavljanju, kako to moderirati kot naknadno misel. Poglejte Facebook Live, storitev pretakanja videoposnetkov, ki ljudem omogoča, da posnamejo vse, kar se trenutno dogaja v njihovem življenju. Za kaj so mislili, da ga bodo ljudje sčasoma uporabili?

To kaže na stalno pomanjkanje razmišljanja o težavah in njihovo proaktivno reševanje, preden se pojavijo. Ali pa se zmotimo na strani: "Hej, počakajmo s tem in poglejmo, kakšen vzklik bo, preden bomo karkoli storili." (Vse v imenu »svobode govora«, seveda ob neupoštevanju dejstva, da je Facebook globalna platforma.) 1

Kam sem spet postavil to smernico za moderiranje?

In morda vse zložiti v en sam priročnik? Torej moderatorji vedo, kje iskati in ali so vse smernice skladne?

Videoposnetki o samopoškodovanju so v Facebookovem svetu popolnoma v redu, ker je oseba "v stiski". Tudi okrutnost nad živalmi (morda zato, ker je žival v stiski?). V redu je tudi "maščevalna pornografija", če moderator ne more potrditi pomanjkanja privolitve obeh strani (kar bi bilo verjetno težko pravočasno izvesti).

"Nekaterih fotografij neseksualne fizične zlorabe in ustrahovanja otrok ni treba izbrisati ali" ukrepati ", če ni sadističnega ali prazničnega elementa." Dokler v nasilnih posnetkih in videoposnetkih ne boste imeli sadizma in praznovanj, jim bo Facebook očitno to dovolil.

V dokumentih piše: »Video posnetki nasilnih smrti so moteči, vendar lahko pomagajo pri ozaveščanju. Za videoposnetke menimo, da mladoletniki potrebujejo zaščito, odrasli pa izbiro. Kot "moteče" označujemo video posnetke nasilne smrti ljudi. " Ni jasno, kje samomorilne vsebine - na primer videoposnetki v živo ali grožnje - spadajo v Facebook-ove politike moderiranja, vendar se zdi, da je dovoljeno.

Facebook mora dati prednost varnosti uporabnikov

Nekateri pozivajo k strožji regulaciji Facebooka, saj je vratar vse te vsebine (podobno kot je televizijska postaja vratar vsebin v svojem omrežju):

Poročilo britanskih poslancev, objavljeno 1. maja, pravi, da "največja in najbogatejša podjetja za družbena omrežja sramotno še zdaleč ne sprejemajo zadostnih ukrepov za boj proti nezakoniti ali nevarni vsebini, za izvajanje ustreznih standardov skupnosti ali za zaščito svojih uporabnikov".

Napaka na strani "svobode govora" se morda zdi dobra ideja, zlasti za ameriško podjetje. Toda socialna omrežja so predvsem spletne skupnosti - niso ravno podobna časopisom. Glavni namen Facebooka je povezati ljudi med seboj. Iz tega sledi, da bi njihove smernice bolj odražale to raznolikost in bile zasnovane za varnost te skupnosti, ne pa nekakšna mantra za objavo novic ali prazna ideologija.

Radi bi, da bi bil Facebook bolj pregleden glede načinov, kako vsak dan moderira milijone ljudi in vsebine. Osvetlitev teh vprašanj pomaga osvetliti težave in daje Facebooku priložnost, da izboljša varnost svoje skupnosti. In radi bi, da bi Facebook veliko več svojega dohodka zagotovil, da bi imel dovolj osebja, da bi zagotovil svojo platformo na varnem. Za vse uporabnike.

Za več informacij

Opombe:

- Oh, in upoštevajte, da če imate na Facebooku še 100.000 sledilcev, ste v njihovih očeh to "javna oseba" - in ne podležete zasebnosti ali drugim zaščitam običajnih ljudi. [↩]